| Auteur |

Xbox One (Eighty) - "J'adore quand un plan se déroule sans accroc..." |

Laurent

Commissaire apolitique

Joue à Super Mario Bros. Wonder

Inscrit : Mar 06, 2002

Messages : 22761

De : Borgo, là où y a la fibre.

Hors ligne |  Posté le: 2013-06-21 15:34 Posté le: 2013-06-21 15:34

J'ai appris la nouvelle hier matin et soudain blam : ligne fixe en dérangement pendant un jour et demi. France Télécom a sans doute voulu s'assurer que j'encourage la nouvelle politique de MS

Bon, ben c'est la fête ces news. Je reviens aux affaires, et à présent je vais pouvoir hanter le topic dédié aux jeux. D'ici fin 2014 il devrait y avoir chez moi une PS4 (mon beau-fils en prendra une, ça paraît inévitable) et une Xbox One. Manque plus que la rétrocomp pour les jeux XBLA et quelques rééditions de jeux Kinect vu que tout le monde aura le périphérique (je ne cracherai pas sur Fable The Journey), et le tableau sera parfait. _________________

|

Manuel

Pixel monstrueux

Inscrit : Jan 02, 2003

Messages : 3907

De : Grenoble

Hors ligne |  Posté le: 2013-06-21 16:54 [ Edité le: 2013-06-21 17:13 ] Posté le: 2013-06-21 16:54 [ Edité le: 2013-06-21 17:13 ]

Tu peux déjà oublié les jeux xbla de la 360 sur la One, aucune rétrocompatibilité de prévu ni possible d'ailleurs vu l'architecture de la console.

Pour le cloud processing ils en parlaient pour l'IA de Forza 5 qui serait "calquée" sur les performances des joueurs mais je doute sérieusement d'un apport sur le plan graphique tant ça serait une usine à gaz à gérer au niveau programmation entre la console et le réseau, ça s'est jamais vu à ma connaissance.

c'est au niveau de la bande passante mémoire que ça m'inquiète un peu, 68Gb/S contre 176Gb/s (merci la DDR5) pour la PS4 qui en plus sera équipée d'un GPU plus véloce.

Le comparatif 360/ONE/PS4 en détails pour les geeks du hardware  : http://www.anandtech.com/show/6972/xbox-one-hardware-compared-to-playstation-4/2

|

Vectrex

Pixel monstrueux

Score au grosquiz

0006880

pts.

Joue à New Astro - MisTer inside

Inscrit : Feb 20, 2003

Messages : 3402

De : la République bananière de Wallonie

Hors ligne |  Posté le: 2013-06-21 17:59 Posté le: 2013-06-21 17:59

On s'est mangé 6 ans d'inferiors versions sur PS3. À chacun son tour merde!  _________________ Steam/PSN/Nintendo Network: Vectrex_EU

id Origin: Lt_Vectrex

|

Kimuji

Pixel monstrueux

Joue à Pillars of Eternity

Inscrit : Jul 04, 2005

Messages : 4372

Hors ligne |  Posté le: 2013-06-21 18:37 [ Edité le: 2013-06-21 18:43 ] Posté le: 2013-06-21 18:37 [ Edité le: 2013-06-21 18:43 ]

J'aime bien comment commence l'article "Although Microsoft did its best to minimize AMD’s role in all of this, the Xbox One features a semi-custom 28nm APU designed with AMD". Ce qui est totalement vrai, Sony et MS ont confié les coeurs de leurs machines à AMD (l'APU qui regroupe CPU et GPU) mais is n'ont pas cité la marque une seule fois lors de leurs conférences... De peur de mettre un peu trop en avant les similitudes entre leurs consoles?

Si les infos sont vraies on se retrouve donc avec une PS4 aux capacités graphiques supérieures grâce à une partie GPU plus puissantes (1152 unités de calcul contre 768) combinée à une bande passante plus élevée, de son côté l'Xbox One proposera probablement des perfs CPU un poil plus importantes grâce à la réactivité plus importante de la DDR3 et de ses 32Mo directement embarqués dans l'APU qui devraient garantir des temps de latence très bas à défaut d'une bande passante énorme. Je me demande si c'est un choix délibéré ou juste économique de la part de MS d'avoir privilégié le CPU par rapport au GPU, je ne sais pas trop si dans le cadre d'un jeu ce petit avantage CPU se remarquera en comparaison de la différence de puissance du GPU de la PS4. En fait je pense que la question est de savoir si les parties CPU et GPU son équilibrées, c'est un point clée d'une bonne config sur PC, les données sont d'abord traitées parle CPU qui ensuite les envoie à la carte graphique ce qui veut dire que:

- un petit CPU couplé à une grosse CG donnera des résultats décevants en termes de fluidité car le CPU ne pourra fournir un flot de données suffisant pour que la CG soit pleinement exploitée. Le CPU va limiter le niveau maximum potentiel d'images par seconde.

-un gros CPU couplé à une petite CG va au contraire saturer celle-ci qui traitera à son rythme réduit la masse de données que le CPU lui balance. Ce qui se traduira par des chutes de framerate importantes dès qu'on rajoutera des effets graphiques un peu gourmands.

Les ingés de Sony et MS n'étant probablement pas des branques ils y ont forcément pensé, mais il y a forcément une solution plus équilibrée que l'autre. Ceci dit pour avoir possédé un PC dont la CG était surdimensionnée par rapport au CPU, bien que si en termes d'images par secondes cette solution a un intérêt limité, en terme de qualité d'image je pouvais par exemple activer moults effets sans réelle perte de performances, mon CPU limitait le nombre d'images par secondes maximum que mon système pouvait fournir par contre activer l'anti-aliasing et autres shaders avait un impact limité sur les performances.

Tout ça pour dire que même si je ne sais pas vraiment si le CPU de la PS4 sera à même de tirer parti du surplus de puissance de son GPU, je m'attends plus ou moins à ce que la PS4 soit capable d'afficher des graphismes plus complexes à un niveau de fluidité supérieur à celui de l'Xbox One dans le cas de jeux lourds graphiquement, par contre dans les cas où la CG n'est pas mise à genou la console de MS aura peut être un petit avantage de fluidité.

|

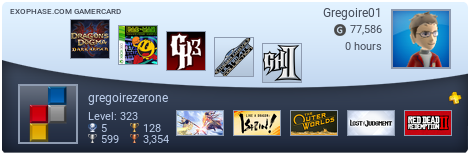

gregoire01

Pixel visible depuis la Lune

Inscrit : Oct 23, 2005

Messages : 6175

Hors ligne |  Posté le: 2013-06-21 19:08 [ Edité le: 2013-06-21 19:18 ] Posté le: 2013-06-21 19:08 [ Edité le: 2013-06-21 19:18 ]

Apparement le fameux partage familial avec 10 amis/membre de la famille était loin d'être le rêve espérer par certain. En faite il semble que si on pouvait préter un jeu, on ne pouvait en fait n'y jouer que 45 minute en moyenne

http://www.heyuguysgaming.com/news/12507/heartbroken-xbox-one-employee-lets-rip-must-read

Citation : First is family sharing, this feature is near and dear to me and I truly felt it would have helped the industry grow and make both gamers and developers happy. The premise is simple and elegant, when you buy your games for Xbox One, you can set any of them to be part of your shared library. Anyone who you deem to be family had access to these games regardless of where they are in the world. There was never any catch to that, they didn’t have to share the same billing address or physical address it could be anyone. When your family member accesses any of your games, they’re placed into a special demo mode. This demo mode in most cases would be the full game with a 15-45 minute timer and in some cases an hour. This allowed the person to play the game, get familiar with it then make a purchase if they wanted to. When the time limit was up they would automatically be prompted to the Marketplace so that they may order it if liked the game. _________________

|

noah

Pixel monstrueux

Joue à SuperMarioWorld [PSP]

Inscrit : Aug 29, 2002

Messages : 2881

Hors ligne |  Posté le: 2013-06-21 19:30 Posté le: 2013-06-21 19:30

Citation : Le 2013-06-21 18:37, Kimuji a écrit :

J'aime bien comment commence l'article "Although Microsoft did its best to minimize AMD’s role in all of this, the Xbox One features a semi-custom 28nm APU designed with AMD". Ce qui est totalement vrai, Sony et MS ont confié les coeurs de leurs machines à AMD (l'APU qui regroupe CPU et GPU) mais is n'ont pas cité la marque une seule fois lors de leurs conférences... De peur de mettre un peu trop en avant les similitudes entre leurs consoles?

Si les infos sont vraies on se retrouve donc avec une PS4 aux capacités graphiques supérieures grâce à une partie GPU plus puissantes (1152 unités de calcul contre 768) combinée à une bande passante plus élevée, de son côté l'Xbox One proposera probablement des perfs CPU un poil plus importantes grâce à la réactivité plus importante de la DDR3 et de ses 32Mo directement embarqués dans l'APU qui devraient garantir des temps de latence très bas à défaut d'une bande passante énorme. Je me demande si c'est un choix délibéré ou juste économique de la part de MS d'avoir privilégié le CPU par rapport au GPU, je ne sais pas trop si dans le cadre d'un jeu ce petit avantage CPU se remarquera en comparaison de la différence de puissance du GPU de la PS4. En fait je pense que la question est de savoir si les parties CPU et GPU son équilibrées, c'est un point clée d'une bonne config sur PC, les données sont d'abord traitées parle CPU qui ensuite les envoie à la carte graphique ce qui veut dire que:

- un petit CPU couplé à une grosse CG donnera des résultats décevants en termes de fluidité car le CPU ne pourra fournir un flot de données suffisant pour que la CG soit pleinement exploitée. Le CPU va limiter le niveau maximum potentiel d'images par seconde.

-un gros CPU couplé à une petite CG va au contraire saturer celle-ci qui traitera à son rythme réduit la masse de données que le CPU lui balance. Ce qui se traduira par des chutes de framerate importantes dès qu'on rajoutera des effets graphiques un peu gourmands.

Les ingés de Sony et MS n'étant probablement pas des branques ils y ont forcément pensé, mais il y a forcément une solution plus équilibrée que l'autre. Ceci dit pour avoir possédé un PC dont la CG était surdimensionnée par rapport au CPU, bien que si en termes d'images par secondes cette solution a un intérêt limité, en terme de qualité d'image je pouvais par exemple activer moults effets sans réelle perte de performances, mon CPU limitait le nombre d'images par secondes maximum que mon système pouvait fournir par contre activer l'anti-aliasing et autres shaders avait un impact limité sur les performances.

Tout ça pour dire que même si je ne sais pas vraiment si le CPU de la PS4 sera à même de tirer parti du surplus de puissance de son GPU, je m'attends plus ou moins à ce que la PS4 soit capable d'afficher des graphismes plus complexes à un niveau de fluidité supérieur à celui de l'Xbox One dans le cas de jeux lourds graphiquement, par contre dans les cas où la CG n'est pas mise à genou la console de MS aura peut être un petit avantage de fluidité.

Globalement sur PC, on est toujours globalement GPU limited. Et là c'est un peu la même chose, les architectures sont identiques à la ram près, donc on peut globalement dire que la PS4 est et sera plus puissante que la XONE, car les développeurs vont avoir deux mêmes machines, sauf que l'une des deux aura une mémoire vive nettement plus performante, donc la messe est dite. Et si déjà on a du 60 fps garanti ce sera génial, on est assez loin des fps de malade d'un pc pensé pour le fps justement.

|

Kaede

Pixel visible depuis la Lune

Inscrit : Mar 06, 2002

Messages : 5255

Hors ligne |  Posté le: 2013-06-21 19:31 [ Edité le: 2013-06-21 19:31 ] Posté le: 2013-06-21 19:31 [ Edité le: 2013-06-21 19:31 ]

Déjà posté hier, Grégoire

|

Nikeleos

Assassin de Doubleur

Joue à Baldur’s Biberon, Tom Clancy's Couche War

Inscrit : Apr 21, 2006

Messages : 1141

Hors ligne |  Posté le: 2013-06-21 19:44 [ Edité le: 2013-06-21 19:44 ] Posté le: 2013-06-21 19:44 [ Edité le: 2013-06-21 19:44 ]

Citation : Le 2013-06-21 19:08, gregoire01 a écrit :

Apparement le fameux partage familial avec 10 amis/membre de la famille était loin d'être le rêve espérer par certain. En faite il semble que si on pouvait préter un jeu, on ne pouvait en fait n'y jouer que 45 minute en moyenne

http://www.heyuguysgaming.com/news/12507/heartbroken-xbox-one-employee-lets-rip-must-read

Citation : First is family sharing, this feature is near and dear to me and I truly felt it would have helped the industry grow and make both gamers and developers happy. The premise is simple and elegant, when you buy your games for Xbox One, you can set any of them to be part of your shared library. Anyone who you deem to be family had access to these games regardless of where they are in the world. There was never any catch to that, they didn’t have to share the same billing address or physical address it could be anyone. When your family member accesses any of your games, they’re placed into a special demo mode. This demo mode in most cases would be the full game with a 15-45 minute timer and in some cases an hour. This allowed the person to play the game, get familiar with it then make a purchase if they wanted to. When the time limit was up they would automatically be prompted to the Marketplace so that they may order it if liked the game.

Je suis complètement abasourdi que certains aient pu y croire.

Tu as un système qui d'un côté te bloque le prêt/achat/vente d'occasion de particulier à particulier et t'oblige à être "surveiller" toutes les 24h et d'un autre côté le système t'autoriserait à partager gratuitement 10 fois un jeu complet ? Y avais pas comme une petite contradiction là ?

Comme l'avait dit quelqu'un précédemment sur ce forum, je suis sidéré à quel point le syndrome de Stockolm s'est développé chez certains.

|

Kimuji

Pixel monstrueux

Joue à Pillars of Eternity

Inscrit : Jul 04, 2005

Messages : 4372

Hors ligne |  Posté le: 2013-06-21 19:46 [ Edité le: 2013-06-21 19:47 ] Posté le: 2013-06-21 19:46 [ Edité le: 2013-06-21 19:47 ]

Citation : Le 2013-06-21 19:30, noah a écrit :

Globalement sur PC, on est toujours globalement GPU limited. Et là c'est un peu la même chose, les architectures sont identiques à la ram près, donc on peut globalement dire que la PS4 est et sera plus puissante que la XONE, car les développeurs vont avoir deux mêmes machines, sauf que l'une des deux aura une mémoire vive nettement plus performante, donc la messe est dite. Et si déjà on a du 60 fps garanti ce sera génial, on est assez loin des fps de malade d'un pc pensé pour le fps justement.

Parce que sur PC on a des CPU plus costauds, ensuite un CPU qui tourne avec de la GDDR5 c'est de l'inédit et c'est moins bien qu'avec de la DDR3, dans le cas d'un CPU les temps de latence réduits sont préférables à une grosse bande passante. C'est une des raisons pour laquelle les Pentium 4 se faisaient défoncer par les Athlons dans les jeux, la RDRAM des P4 proposait une bande passante énorme comparée à la DDR des Athlons mais les temps de latence étaient trop grands. D'ailleurs à la génération suivante Intel est revenu sur de la DDR.

Alors certes généralement dans un jeu la CG est plus déterminante que le CPU (si celui-ci n'est pas trop à la ramasse évidement), mais dire que la GDDR5 c'est mieux que de la DDR3 ce n'est pas exacte. La GDDR5 ne favorisera que la partie graphique, la partie CPU préfère la DDR3. La console idéale, et donc hors de prix, embarquerait les deux.

|

Simbabbad

Pixel planétaire

Score au grosquiz

0000684

pts.

Inscrit : Feb 28, 2006

Messages : 10798

Hors ligne |  Posté le: 2013-06-21 19:54 Posté le: 2013-06-21 19:54

|

Nikeleos

Assassin de Doubleur

Joue à Baldur’s Biberon, Tom Clancy's Couche War

Inscrit : Apr 21, 2006

Messages : 1141

Hors ligne |  Posté le: 2013-06-21 20:07 Posté le: 2013-06-21 20:07

Citation : Le 2013-06-21 19:54, Simbabbad a écrit :

Citation : Le 2013-06-21 19:44, Nikeleos a écrit :

Je suis complètement abasourdi que certains aient pu y croire.

C'est parce qu'on essaie de rester positifs  !

C'est une bonne attitude, c'est vrai...

Bon, en même temps on parle quand même de Microsoft là.  _________________ Carl : J’ai commencé sur Commodore 64 avant de passer sur Atari ST

Youpla : Dommage, t’étais bien parti.

|

Kimuji

Pixel monstrueux

Joue à Pillars of Eternity

Inscrit : Jul 04, 2005

Messages : 4372

Hors ligne |  Posté le: 2013-06-22 03:28 Posté le: 2013-06-22 03:28

Citation : Le 2013-06-21 19:30, noah a écrit :

Et si déjà on a du 60 fps garanti ce sera génial, on est assez loin des fps de malade d'un pc pensé pour le fps justement.

J'avais zapé ça, du "60 fps garanti" ça ne veut rien dire, c'est totalement indépendant de la puissance de ta machine. Le nombre d'images par seconde ça dépend avant tout de la lourdeur de la scène, tu peux avoir un jeu qui tourne à 60 fps sur une Psone parce qu'il n'a que 3 polygones à animer et des textures en super basse résolution et un jeu qui va se trainer à 20 images par secondes sur un PC surpuissant parce qu'il y a des polygones dans tous les sens, des textures super lourdes et plein d'effets et de post processing. Le 60 fps c'est 100% dépendant du choix des développeurs, de l'équilibre qu'ils vont trouver entre les perfs brutes de la machine et la demande en ressources du jeu qui tourne dessus.

|

FF_Clad

Pixel monstrueux

Inscrit : May 31, 2002

Messages : 2599

Hors ligne |  Posté le: 2013-06-22 08:14 Posté le: 2013-06-22 08:14

On a deja connu des exemples assez extreme de desequilibre GPU/CPU.

La Megadrive avait un CPU du feu de dieu qui deboitait tout, surtout en 1989 ! Mais la puce de traitement graphique etait ridicule face a la SNES. En revanche, la SNES avait un pauvre petit CPU anemique qui se trainait.

C'est pour ca que Sonic n'aurait jamais ete possible sur Megadrive, et F-Zero sur SNES. _________________ Citation : Le 2012-03-15 15:32, Warner a écrit :

SEGA fait bel et bien des jeux de merde.

Citation : Le 2013-02-06 21:10, Shenron a écrit :

Sega assure niveau marketing.

|

Kaede

Pixel visible depuis la Lune

Inscrit : Mar 06, 2002

Messages : 5255

Hors ligne |  Posté le: 2013-06-22 11:25 [ Edité le: 2013-06-22 11:26 ] Posté le: 2013-06-22 11:25 [ Edité le: 2013-06-22 11:26 ]

Citation : Le 2013-06-22 03:28, Kimuji a écrit :

Citation : Le 2013-06-21 19:30, noah a écrit :

Et si déjà on a du 60 fps garanti ce sera génial, on est assez loin des fps de malade d'un pc pensé pour le fps justement.

Le 60 fps c'est 100% dépendant du choix des développeurs

+1

Mais comme :

- la majorité semble s'en taper

- ça ne se voit pas sur des screenshots

- ça ne se voit pas sur des trailers (vous connaissez beaucoup de players affichant 60fps ? c'est très rare)...

... ben on se traîne à 30fps. 60fps c'est toujours à portée de main, il faut lâcher un peu de lest, c'est tout.

|

RobertGlucose

Pixel monstrueux

Inscrit : Feb 06, 2005

Messages : 2589

Hors ligne |  Posté le: 2013-06-22 11:30 Posté le: 2013-06-22 11:30

Citation : Le 2013-06-22 03:28, Kimuji a écrit :

tu peux avoir un jeu qui tourne à 60 fps sur une Psone parce qu'il n'a que 3 polygones à animer et des textures en super basse résolution

|

dante2002

Déterreur de topics

Score au grosquiz

0002009

pts.

Joue à Le GamePass sur la Serie X

Inscrit : Feb 10, 2003

Messages : 5365

De : METZ

Hors ligne |  Posté le: 2013-06-22 11:31 Posté le: 2013-06-22 11:31

Citation : Le 2013-06-21 17:59, Davios a écrit :

On s'est mangé 6 ans d'inferiors versions sur PS3. À chacun son tour merde!

Pour les jeux multi (de merde  ).

Les jeux exclusifs ps3 sorties après 2009 sont infaisables sur xbox360... _________________

|

dante2002

Déterreur de topics

Score au grosquiz

0002009

pts.

Joue à Le GamePass sur la Serie X

Inscrit : Feb 10, 2003

Messages : 5365

De : METZ

Hors ligne |  Posté le: 2013-06-22 11:40 Posté le: 2013-06-22 11:40

Par contre, là où les deux contstructeurs jouent petit bras, c'est sur le disque dur.

Surtout si on vends du dématérialisé.

Perso j'ai remplacé le dd de ma ps3 parce qui rentrait de plus gros (un 70 go), et en étant abonné au ps+ depuis le début j'en ai déjà utilisé 480... _________________

|

Erhynn Megid

Pixel planétaire

Score au grosquiz

0004551

pts.

Joue à Freelancer

Inscrit : Nov 22, 2003

Messages : 13043

De : Orléans

Hors ligne |  Posté le: 2013-06-22 13:04 Posté le: 2013-06-22 13:04

@dante2002 :

A ceci près que contrairement à la XBone, on pourra changer le HDD de la PS4 par un autre, sans difficulté. Le constructeur qui m'a le plus agréablement surpris sur ce point, c'est Nintendo et la Wii U : un disque dur (et maintenant deux) USB au derrière et en voiture Simone. _________________ Super Putty Squad, Mega Man 11, Bubsy 4, Sonic Mania... où est mon nouveau Turrican ?

|

noah

Pixel monstrueux

Joue à SuperMarioWorld [PSP]

Inscrit : Aug 29, 2002

Messages : 2881

Hors ligne |  Posté le: 2013-06-22 13:09 Posté le: 2013-06-22 13:09

Citation : Le 2013-06-22 03:28, Kimuji a écrit :

Citation : Le 2013-06-21 19:30, noah a écrit :

Et si déjà on a du 60 fps garanti ce sera génial, on est assez loin des fps de malade d'un pc pensé pour le fps justement.

J'avais zapé ça, du "60 fps garanti" ça ne veut rien dire, c'est totalement indépendant de la puissance de ta machine. Le nombre d'images par seconde ça dépend avant tout de la lourdeur de la scène, tu peux avoir un jeu qui tourne à 60 fps sur une Psone parce qu'il n'a que 3 polygones à animer et des textures en super basse résolution et un jeu qui va se trainer à 20 images par secondes sur un PC surpuissant parce qu'il y a des polygones dans tous les sens, des textures super lourdes et plein d'effets et de post processing. Le 60 fps c'est 100% dépendant du choix des développeurs, de l'équilibre qu'ils vont trouver entre les perfs brutes de la machine et la demande en ressources du jeu qui tourne dessus.

Mon post ne doit pas être assez clair, je partage complètement ton analyse technique, mon humble avis c'est qu'aujourd'hui pour une machine de jeu, il vaut mieux dans l'arbitrage CPU/GPU privilégier ce dernier composant, tant les plateformes actuelles sont d'avantage GPU limited que CPU limited.

|

Jika

Pixel planétaire

Inscrit : Mar 27, 2003

Messages : 11567

Hors ligne |  Posté le: 2013-06-24 13:07 Posté le: 2013-06-24 13:07

|